RAG (Retrieval Augmented Generation) es una técnica utilizada para ampliar la capacidad de respuesta de LLMs, combinando el conocimiento interno del modelo de lenguaje con sistemas de recuperación de información.

Es decir, el modelo busca información relevante en bases de datos externas, como bases de datos o documentos organizacionales, antes de generar una respuesta, lo que permite el acceso a datos actualizados, especializados o muy específicos sin la necesidad de reentrenar el modelo.

Es una idea simple pero poderosa, con aplicaciones prácticas en cualquier área que se beneficie de un sistema con LLM.

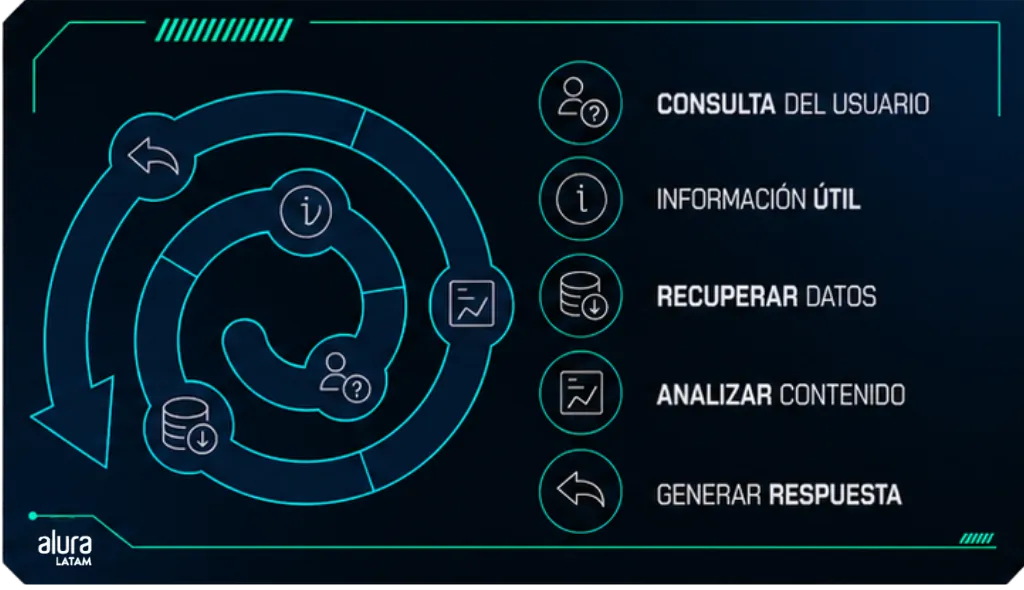

El funcionamiento de RAG puede entenderse como una colaboración entre dos partes principales.

Primero, tenemos el componente de recuperación, que actúa buscando información en fuentes externas.

Luego, entra el componente de generación, donde el modelo de lenguaje utiliza la información recuperada para crear respuestas contextualizadas y de alta calidad.

De esta forma, tenemos una solución para las limitaciones de los LLMs en términos de precisión, relevancia y control de información.

¿Por qué es importante RAG?

Los modelos de lenguaje poseen limitaciones que comprometen su confiabilidad, y RAG puede ser la solución para varias de ellas.

RAG es esencial para mitigar las siguientes limitaciones de las LLMs:

- Respuestas fabricadas: Cuando el modelo no posee una respuesta adecuada, inventa información, lo que conocemos como alucinación.

- Desactualización de datos: Como los LLMs tienen una fecha de corte en relación con su entrenamiento, no pueden acceder a eventos o cambios recientes, lo que reduce su utilidad en diversos contextos.

- Confusión terminológica: Términos similares, pero con significados distintos en diferentes contextos, pueden llevar al modelo a generar respuestas imprecisas.

- Falta de transparencia: Los modelos no son capaces de citar fuentes e indicar el origen del texto generado.

Con la adopción de RAG, los LLMs se convierten en herramientas mucho más confiables, ya que son capaces de acceder e incorporar conocimiento externo.

¿Cómo funciona RAG en la práctica?

El proceso funciona así: el usuario hace una pregunta, el sistema identifica qué información externa puede ser útil, realiza la búsqueda y lleva los datos al modelo.

El modelo, entonces, analiza el contenido y produce una respuesta integrada, utilizando tanto el material recuperado como su propio repertorio.

Este flujo garantiza que las respuestas sean más precisas y actualizadas. Analicemos más detalladamente cada parte de este proceso.

El modelo se conecta con bases de conocimiento externas, como API, bases de datos o documentos organizacionales.

Estas bases se traducen a representaciones matemáticas llamadas embeddings (vectores).

Estas representaciones permiten que el modelo compare la consulta del usuario con los datos disponibles e identifique la información más relevante basándose en cálculos de similitud vectorial.

Un chatbot de RR.HH., por ejemplo, puede buscar directamente las políticas específicas de vacaciones al responder a preguntas como "¿Cuántos días de vacaciones tengo?".

A continuación, ocurre el enriquecimiento del contexto: la información recuperada se integra al prompt del usuario para que el modelo genere respuestas más específicas y contextualizadas.

Estos datos externos pueden actualizarse constantemente, ya sea en tiempo real o mediante procesos periódicos, garantizando que el conocimiento utilizado esté siempre alineado con el momento actual.

Principales beneficios de RAG

La adopción de RAG aporta una serie de ventajas que la hacen esencial para organizaciones y desarrolladores de IA:

- Reducción de costos operativos: Entrenar nuevamente un LLM para cada nueva actualización de conocimiento es un proceso costoso y lento. RAG elimina esta necesidad al integrar datos externos, haciendo que el uso de IA generativa sea más accesible.

- Información actualizada: Conectar el modelo a fuentes de datos en tiempo real le permite proporcionar respuestas basadas en los acontecimientos más recientes, algo esencial para áreas como el periodismo, la atención al cliente y el análisis financiero.

- Aumento de la confiabilidad: Con la capacidad de citar fuentes y ofrecer transparencia, el sistema gana la confianza de los usuarios. La trazabilidad de la información también es un punto clave para aplicaciones corporativas y científicas.

- Control personalizado: Los desarrolladores pueden ajustar las fuentes de conocimiento utilizadas por el modelo, garantizando que esté alineado con los objetivos de la organización y evitando la exposición de información sensible.

Ejemplos de aplicación de RAG

Con esta técnica, es posible tener un sistema con IA que sea seguro y confiable en cualquier contexto.

En el entorno corporativo, por ejemplo, los asistentes virtuales equipados con RAG pueden acceder a políticas internas, historiales de soporte y bases de conocimiento técnico para generar respuestas precisas para los empleados.

En el área de la educación, los sistemas de apoyo a alumnos y profesores pueden buscar en materiales didácticos actualizados, artículos científicos y guías de estudio, ayudando a crear planes de clase o a resolver dudas.

En el comercio electrónico, los chatbots pueden proporcionar información detallada a los clientes: ya sea sobre productos, para aclarar políticas de devolución o para realizar el seguimiento del estado de los pedidos.

¿Has pensado cómo aplicar RAG puede beneficiar tu trabajo? ¡Tenemos cursos que te mostraran las ventajas del uso de RAG! Sigue nuestras novedades.

RAG no es solo una solución técnica, sino un cambio en la forma en que los modelos de IA interactúan con el mundo real, haciéndolos más útiles y confiables. ¿Estás listo para explorar las posibilidades?

¡Domine RAG y agentes de IA en menos de 4 horas!

¿Tienes poco tiempo pero necesita dominar la tecnología que está revolucionando la industria? En cuestión de horas, este curso práctico te llevará de la mano por el ecosistema de LangChain. Aprenderás a configurar e instanciar LLMs, controlar sus salidas con prompts avanzados y conectar estos modelos a datos reales mediante la creación y almacenamiento de embeddings en bases de datos vectoriales.

¡Y no se queda solo en la teoría! Construiras sistemas de respuesta precisos con RAG (Generación Aumentada por Recuperación) y crearas agentes autónomos e inteligentes utilizando grafos de estado con LangGraph. Prueba y ejecuta sus propios agentes en diferentes escenarios y termina con un proyecto real para tu portafolio. Acelera tu carrera, evita alucinaciones de la IA y garantiza tu certificado de Alura para destacar en el mercado laboral.